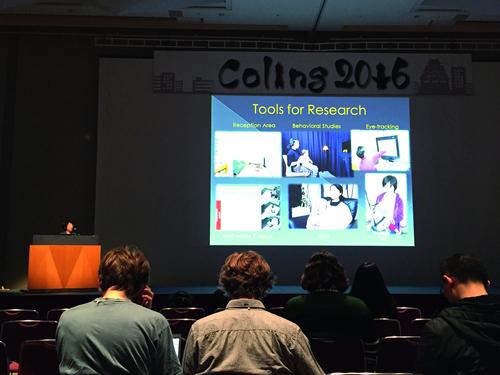

第26届国际计算语言学大会(The 26th International Conference on Computational Linguistics, COLING 2016)于2016年12月11~16日在日本大阪召开。本届会议参会人员达1000人左右。该会议的一大特点在于其广博,也被认为是该会议的精神。会议涉及18个主题领域,基本囊括了计算语言学中的所有话题。

国际计算语言学大会也强调对语言本身的重视,已经成为计算语言学的招牌会议之一,是中国计算机学会(CCF)推荐的B类国际学术会议。该会议自1965年开始举办由国际计算语言学学会(The International Committee on Computational Linguistics, ICCL)组织,一般每两年举办一届。

特邀报告

本次会议邀请了瑞典乌普萨拉(Uppsala)大学的若阿基姆·尼维尔(Joakim Nivre)教授、杜克大学的瑞可·玛祖卡(Reiko Mazuka)教授、美国国家医学图书馆(U.S. National Library of Medicine)的迪娜·德姆内尔-富士曼(Dina Demner-Fushman)教授和剑桥大学的西蒙妮·托伊费尔(Simone Teufel)教授作特邀报告。

尼维尔的报告题目为“通用依存——可疑的语言学和糟糕的句法分析?(Universal Dependencies – Dubious Linguistics and Crappy Parsing?)”。通用依存是由尼维尔教授牵头开发的面向多语言的依存语料库。然而,一些评论认为,通用依存的标注规范背离了理论语言学,从而影响了依存句法分析的效果。尼维尔对此进行了解释,阐明了对通用依存标注规范的另一种解读能与理论语言学相符,也能改善依存句法分析技术。

玛祖卡的报告题目为“取得正确的输入:完善理解儿童听到的语言(Getting the Input Right: Refining Our Understanding of What Children Hear)”。玛祖卡指出,之前儿童语言习得的研究中,由于缺乏对输入语料(即儿童实际听到的语言)的细致分析而做了某些假设。但是,在对输入语料进行详细标注与分析后,发现这些假设并不成立,从而推翻了之前的结论。这启示我们要认真对待输入语料的分析,而不要想当然地做出不合实际的假设。

迪娜的报告题目为“支持医疗任务与决策的自然语言处理(NLP to Support Clinical Tasks and Decisions)”,介绍了自然语言处理在医疗领域已有的成功应用。

托伊费尔的报告题目为“从文本理解的视角看计算论证学和文本摘要(A Look at Computational Argumentation and Summarisation from a Text-Understanding Perspective)”。托伊费尔介绍了计算论证学这一新兴领域,讨论了它与文本摘要的相通之处,认为两者都需要大量世界知识的支持,而增强计算机在这方面的能力则有赖于文本理解技术的发展。

会议论文

本次会议共收到1039篇有效论文投稿,被划分到18个主题领域。每个主题领域由至少两位领域主席负责,组织了超过800位审稿人进行审稿,几乎每篇投稿都获得至少3位审稿人的意见。大会最终录用了337篇论文,录用率为32.4%。

18个主题领域大致可以划分为三类。第一类涉及语言分析任务,包括形态学、分词、词性标注、词组切分,句法分析,词汇语义,语义处理,文本蕴涵,篇章分析,情感分析与计算论证学。第二类为语言生成任务,包括自然语言生成与摘要,信息检索、抽取与问答,对话系统,机器翻译。其余主题可归为第三类,包括自然语言处理中的语言学问题,计算心理语言学,用于自然语言处理的机器学习,资源与工具,小语种,语音处理,以及自然语言处理技术的应用。

在语言分析任务中,与语义相关的研究方兴未艾。以若干年前word2vec工具的发表为标志,近年来对基于词向量模型的语义研究一直如火如荼。词汇的表示作为自然语言处理的基础,词向量模型已经被应用在各种各样的任务中,如词对齐(“Improving Word Alignment of Rare Words with Word Embeddings”[1])、时间关系分类(“On the Contribution of Word Embeddings to Temporal Relation Classification” )、情感分析(“Borrow a Little from Your Rich Cousin: Using Embeddings and Polarities of English Words for Multilingual Sentiment Classification”,“Word Embeddings and Convolutional Neural Network for Arabic Sentiment Classification” )、语义角色标注(“Facing the Most Difficult Case of Semantic Role Labeling: A Collaboration of Word Embeddings and Cotraining” )、话题标注(“Automatic Labelling of Topics with Neural Embeddings” )等。随着各式各样的词向量模型被提出,研究界开始更为深入地理解这些模型学到的词汇表示,并以更为审慎的态度对待这些模型的评价与使用(“Word Embeddings, Analogies, and Machine Learning: Beyond king - man + woman = queen”,“Bad Company—Neighborhoods in Neural Embedding Spaces Considered Harmful” )。

机器翻译是自然语言处理最为古老的任务之一,可以认为是第二类语言生成任务的代表。目前,神经机器翻译技术可以说已成主流。由于提出的时间并不长,当前仍有不少工作致力于从各个角度改善神经机器翻译系统的效果,如注意力机制(“Interactive Attention for Neural Machine Translation”, “Neural Machine Translation with Supervised Attention” )、预翻译(“Pre-Translation for Neural Machine Translation” )、翻译单元建模(“A Character-Aware Encoder for Neural Machine Translation” )等。由于神经机器翻译的可解释性较差,对于神经机器翻译结果的分析还处于较为初级的阶段(“What Makes Word-level Neural Machine Translation Hard: A Case Study on English-German Translation” )。相比之下,统计机器翻译使更为高层的分析成为可能,如对对话翻译的分析(“Measuring the Effect of Conversational Aspects on Machine Translation Quality” )。

语言学的知识可以帮助研究自然语言处理技术;反过来,自然语言处理也愈发成为语言学研究的重要工具。以语言拓扑学为例,前者包括一篇综述文章(“Survey on the Use of Typological Information in Natural Language Processing” )和一篇机器翻译方面的文章(“Universal Reordering via Linguistic Typology” ),后者则有一篇关于语言谱系的研究文章(“Contrasting Vertical and Horizontal Transmission of Typological Features” )。

最佳论文

本次会议评选出两篇最佳论文。一篇是“Predicting Human Similarity Judgments with Distributional Models: The Value of Word Associations”,介绍了使用分布式模型进行词汇表示方面的工作。文章的特点在于用于模型训练的语料。以往的工作都是使用外部的文本语料进行训练,而使用更贴近人脑认知规律的词汇关联语料学到的词汇表示与人类关于词汇相关性和相似性的判断更相符。这样的语料和模型也使得深入探究人脑认知成为可能。

另一篇是“Extending the Use of Adaptor Grammars for Unsupervised Morphological Segmentation of Unseen Languages”,介绍了进行无监督形态切分方面的工作。作者使用了适配器语法(adaptor grammar)的框架,探索了不同形式的语法、外部的形态学知识和一种级联架构。完全无监督是其区别于前人工作的一大特点。

此外,还有一篇论文获得了最佳论文入围奖:“Keystroke Dynamics as Signal for Shallow Syntactic Parsing”。这篇文章的亮点在于使用了一种新颖的信息源——键盘敲击日志。人们敲击键盘的行为特点蕴含了语言的句法信息,可以被用来显著改善浅层句法分析的效果。

总结和展望

国际计算语言学大会对计算科学和语言学都相当重视,在会场上可以感受到两种思潮交相辉映。计算机背景的学者往往重视任务效果的提升、计算可行性和实用场景等方面;而语言学、心理学、认知科学背景的学者则更重视模型的理论意义和科学意义。两种思潮的完美融合是最理想的。会议评选出的最佳论文可以说是融合了多门学科精华的典范之作。

计算语言学作为计算机科学和语言学的交叉学科,必将逐步着手应对更为棘手的语言任务,这从会议设置的一些新兴主题可见一斑,如对话系统、篇章分析、语用学和计算论证学等。虽然目前发表的论文数目还较少,研究的问题也较为初步,但这些是使计算机理解人类语言的必由之路。另一方面,对人类语言和认知的本质理解仍然是一个长远的话题,相信它将随着计算技术的发展得以深入。■

[1]引号内为相关论文题目,下同。

所有评论仅代表网友意见